Ce projet fait le lien entre l’apprentissage machine et les sciences cognitives afin de permettre une meilleure collaboration entre humain et robot. L’objectif global d’OSTENSIVE est de permettre aux robots d’effectuer au mieux des tâches en collaboration avec des humains, grâce à une meilleure communication et compréhension entre les deux acteurs. En intégrant le point de vue de l’humain dans la perception, la décision et la génération d’actions, nous visons à développer des modèles capables de s’adapter aux états mentaux et aux comportements des humains.

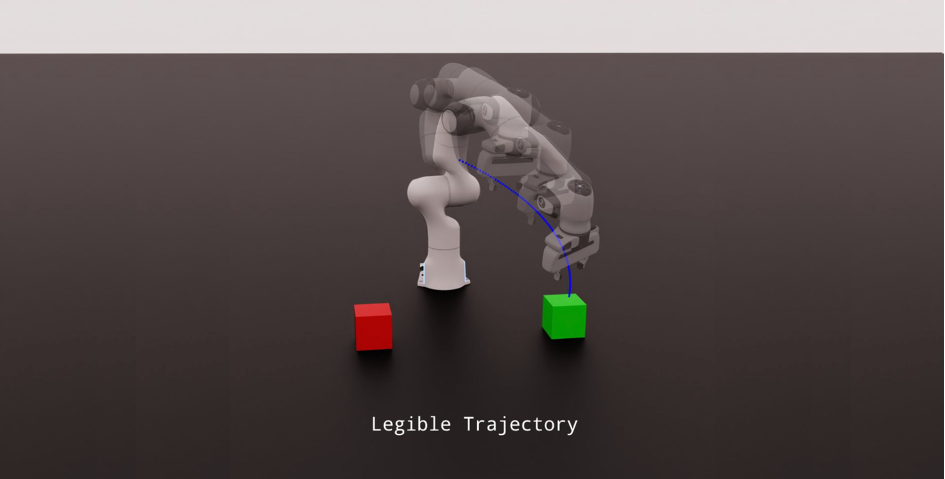

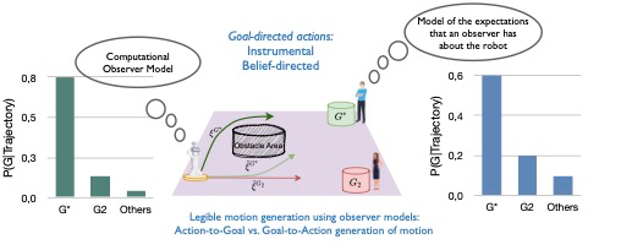

En collaboration avec l’Inria et le LAAS, nous souhaitons développer des modèles d’apprentissage dits directs et inverses permettant d’intégrer la communication à l’action, depuis les modèles de raisonnement et de planification jusqu’à la réalisation de mouvements.

Le contexte

Lorsqu’un humain effectue une démonstration, celle-ci ne se limite pas aux objets manipulés. Elle s’accompagne également d’indices communicatifs ostensibles, tels que le regard et/ou des modulations spatio-temporelles. Ces comportements, comme les pauses, les répétitions et les exagérations, peuvent paraître sous-optimaux, mais ils sont utilisés par l’humain pour communiquer.

Les sciences cognitives abordent ce défi de la communication en action en s’inspirant du langage. La plupart des approches de l’interaction humain-robot supposent une interprétation littérale des comportements, ce qui limite fortement l’interprétation des actions et des intentions de l’autre. Il est nécessaire de disposer de modèles directs et inverses capables de générer un contenu pertinent pour l’autre (humain ou robot) et d’interpréter correctement ses actions.

Les objectifs

Le projet OSTENSIVE vise à développer des modèles directs et inverses, basés sur l’apprentissage machine et conditionnés par des mécanismes de raisonnement relatifs à l’humain. Nos recherches couvrent un large éventail de domaines, allant du développement de modèles de haut niveau pour le raisonnement et la planification des tâches à la mise en œuvre d’une planification de mouvement de bas niveau pour une exécution physique précise.

En nous appuyant sur des approches issues des sciences cognitives, nous étudierons les situations, les indicateurs et les métriques permettant de déterminer les conditions dans lesquelles les humains interagissent avec ces modèles et en tirent profit, grâce à de nouvelles approches d’évaluation en temps réel de la prise de perspective de l’observateur. Nous développerons de nouveaux modèles capables de synthétiser des mouvements robotiques ostensifs et interactifs, ainsi que des représentations probabilistes d’actions ostensives apprises à partir de démonstrations humaines.

Les résultats

Notre objectif est d’adapter et d’étendre les protocoles expérimentaux utilisés pour étudier la cognition sociale. Les applications couvrent de nombreux secteurs, notamment la navigation sociale et la manipulation mobile en environnement partagé. Nous souhaitons garantir que les robots puissent se déplacer avec fluidité et accomplir des tâches aux côtés des humains dans des scénarios réalistes, grâce à l’intégration d’actions ostensives sur différentes plateformes robotiques.

Les travaux d’OSTENSIVE, menés à plusieurs niveaux, visent notamment à permettre aux robots de comprendre et d’interpréter correctement les intentions humaines, de définir des plans explicables pour accomplir des tâches et d’effectuer des actions de manière compréhensible pour un observateur humain.

Après approbation éthique, nous mènerons des expériences approfondies afin de valider les capacités de communication ostensive des robots auprès de participant-es novices qui devraient tirer le meilleur parti de ces capacités pour accomplir une tâche avec le robot.

Partenariats et collaborations

OSTENSIVE est une initiative collaborative entre l’ISIR, le LAAS-CNRS et l’INRIA visant à créer un cadre unifié pour l’interaction humain-robot. L’ISIR coordonne ce projet ANR OSTENSIVE (ANR-24-CE33-6907-01).

ISIR – Équipe ACIDE

– Développement de modèles d’inférence directe et inverse, avec des travaux sur la compréhension de l’intention humaine et la prédiction de l’impact des actions d’un agent sur la perception humaine.

– Référent OSTENSIVE : Mohamed Chetouani

INRIA (Nancy) – Équipe LARSEN

– Étude des mouvements ostensifs, grâce à des outils tels que les primitives de contrôle et les politiques robotiques.

– Référente OSTENSIVE : Serena Ivaldi

LAAS-CNRS (Toulouse) – Équipe RIS

– Réalisation de méthodes de planification prenant en compte la présence des humains, par l’utilisation de la théorie de l’esprit et de la prise de perspective d’un observateur externe.

– Référent OSTENSIVE : Rachid Alami

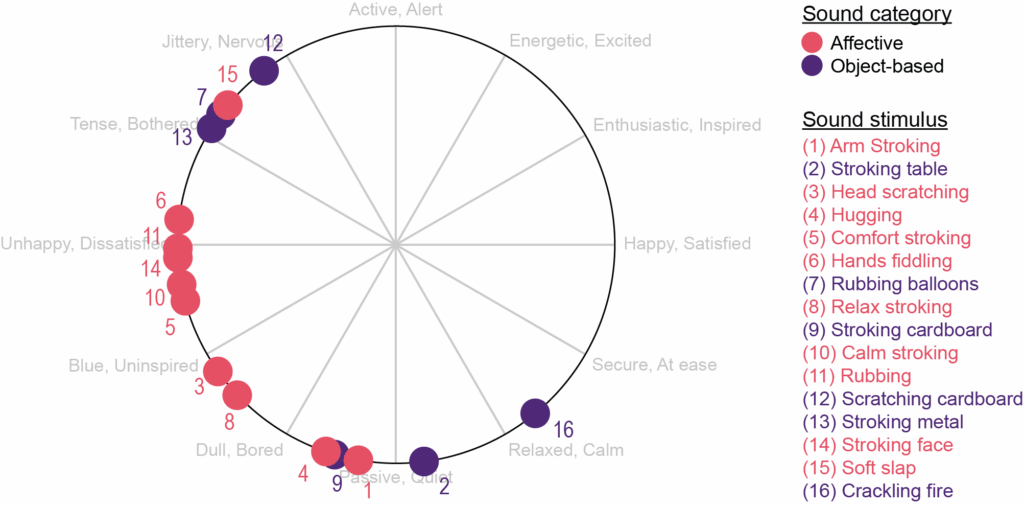

L’étude a examiné les émotions suscitées par l’écoute de sons correspondant à l’enregistrement de gestes tactiles affectifs organiques, c’est-à-dire réels (par exemples, caresse de l’avant-bras, effleurement de la joue). Les gestes ont été enregistrés sur d’autres personnes que ceux qui les écoutent et ils sont présentés de manière isolée. L’étude a été motivée par la diminution constante de l’engagement dans le toucher interpersonnel, en grande partie due à la numérisation de l’expérience humaine. Cette diminution a montré des effets délétères sur les individus et les prive (tant les personnes qui touchent que celles qui sont touchées) des nombreux bénéfices du toucher affectif, notamment la régulation émotionnelle. Il devient donc particulièrement pertinent d’étudier des moyens alternatifs de transmettre les bénéfices du toucher affectif, par exemple via différentes modalités sensorielles. Ici, le son constitue une option intéressante compte tenu de la relation étroite entre les ondes auditives et tactiles.

Le contexte

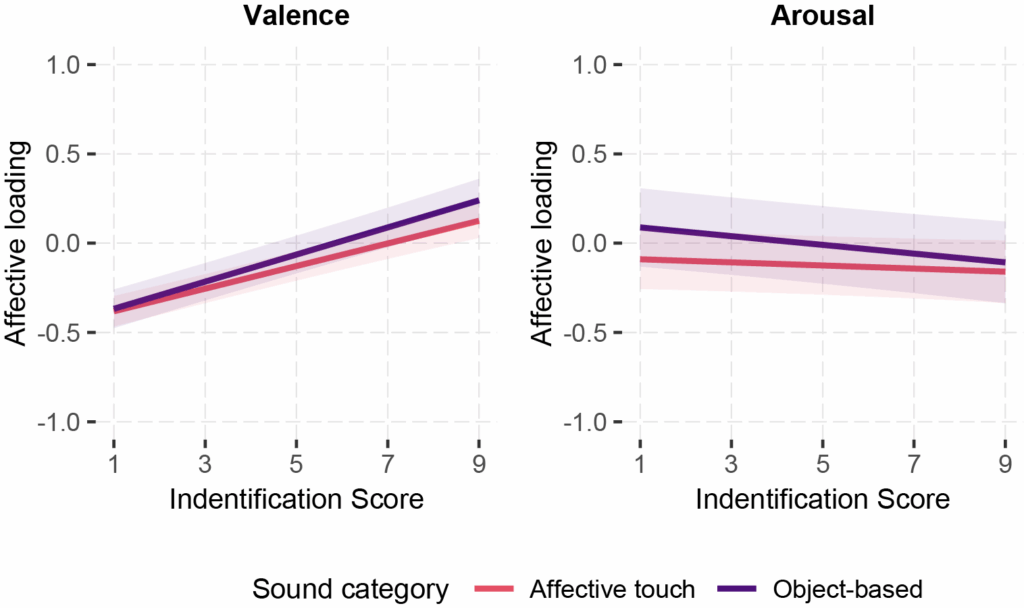

L’étude s’inscrit dans le cadre du projet ANR MATCH Audio-Touch. Elle prolonge la première étude de ce projet en investiguant les réponses émotionnelles aux sons de toucher affectif au-delà de la simple identification, et en examinant l’influence du sens (meaning) et des attentes préalables concernant ce à quoi devrait ressembler des toucher sonores selon les participants et participantes.

Les objectifs

L’objectif principal de l’étude est d’examiner l’espace émotionnel des indices auditifs produits par le toucher affectif organique, présenté isolément, ainsi que les dimensions qui l’influencent. Ces sons peuvent-ils évoquer des émotions positives ? Existe-t-il des variables qui renforcent ces émotions ? Pour ce faire, nous avons mené cinq expériences afin de dissocier les réponses émotionnelles au toucher affectif organique et d’identifier les variables clés qui les modulent.

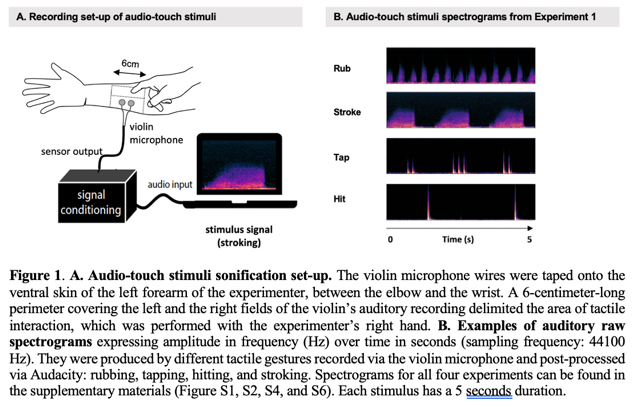

Nous avons extrait des sons générés par des gestes tactiles affectifs organiques en recrutant 14 couples engagés dans une relation et en enregistrant les gestes tactiles qu’ils pratiquent habituellement, ce qui a produit une grande variété de sons de toucher affectif. L’objectif de recourir à des gestes spontanés, plutôt qu’à des gestes prédéfinis, était d’évaluer plus écologiquement le traitement psychologique du toucher affectif et de ses indices multisensoriels, et d’en saisir les nuances.

Les résultats

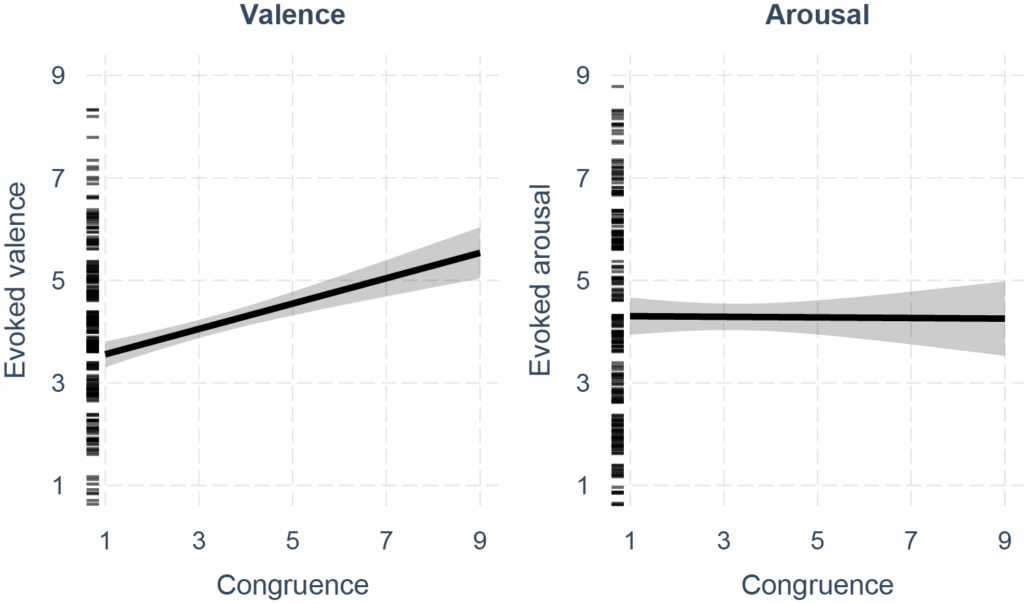

Globalement, nous avons constaté que les seuls sons du toucher affectif suscitaient des réponses émotionnelles caractérisées par une positivité réduite et un niveau d’activation (arousal) légèrement plus élevé, et que les individus avaient une capacité limitée à identifier le toucher affectif à partir d’indices auditifs. En résultats important, nous avons montré que le sens compte. Le fait de présenter explicitement les sons comme relevant d’un toucher affectif organique, plutôt que de ne fournir aucun contexte ou de les présenter comme des interactions avec des objets, augmente la valence qu’ils évoquent. De plus, plus les sons correspondent à ce que les individus s’attendaient initialement à entendre comme sons de toucher affectif, plus la valence suscitée par ces sons est élevée, bien que les personnes disposent de connaissances et d’attentes limitées concernant les sons du toucher affectif. Notre étude est la première à examiner l’espace émotionnel de la dimension auditive du toucher affectif, un champ émergent en soi, riche en perspectives.

D’un point de vue appliqué, nos résultats peuvent servir à renforcer les réponses émotionnelles à des stimuli non tactiles dans le cadre d’interactions interpersonnelles. Par exemple, imaginez la narration d’une histoire émotionnelle incluant des interactions tactiles affectives entre les personnages : les sons de touchers organiques pourraient être utilisés pour amplifier les émotions que ces interactions visent à transmettre. Une autre possibilité est l’amélioration des réponses émotionnelles lors d’interactions numériques avec des agents humains et non humains (par exemples, robots, agents d’IA anthropomorphisés). Il importe toutefois de souligner que des recherches supplémentaires sur le toucher multisensoriel et ses applications sont nécessaires.

Partenariats et collaborations

L’étude s’inscrit dans le cadre de l’ANR Match, dans lequel nous collaborons avec Catherine Pelachaud (ISIR), Ouriel Grynszpan (Université Paris-Saclay) et Indira Thouvenin (UTC Compiègne). Nous avons aussi collaboré avec le Behavioural Lab d’INSEAD–Sorbonne Université, qui nous a aidés à recruter les 14 couples et a mis à disposition les infrastructures physiques nécessaires à l’enregistrement des stimuli expérimentaux.

L’approche du projet Audio-touch combine les résultats de la recherche sur le toucher social et sur la sonification du mouvement, ce qui permet d’extraire certaines caractéristiques significatives des interactions tactiles et de les convertir en sons. Dans les études expérimentales du projet, les participant-es qui écoutaient les stimuli audio-touch peau à peau ont associé avec précision les sons à des gestes spécifiques et ont identifié de façon cohérente les intentions socio-émotionnelles sous-jacentes aux touchers convertis en sons.

De plus, les mêmes mouvements ont été enregistrés avec des objets inanimés, et des expériences supplémentaires ont révélé que la perception des participant-es était influencée par les surfaces impliquées dans les interactions tactiles (peau ou plastique). Cette approche audio-touch pourrait être un tremplin pour donner accès à l’expérience ineffable du toucher social à distance, avec des agents humains ou virtuels.

Le contexte

Le toucher est la première modalité sensorielle à se développer, et le toucher social a de nombreux effets bénéfiques sur le bien-être psychologique et physiologique des individus. Les situations de carences en touchers sociaux accentuent les sentiments d’isolement, d’anxiété et le besoin de lien social. Face à ce constat, il devient urgent d’explorer des moyens de recréer, à distance, les effets bénéfiques du toucher affectif.

Ce projet est né de cette urgence, mais aussi d’une observation fondamentale : le toucher et l’audition partagent une base physique commune, celle des vibrations. Les études de sonification ont déjà montré qu’il était possible de traduire des mouvements et leurs propriétés en sons. Il devient alors envisageable de traduire certaines caractéristiques des interactions peau à peau en signaux auditifs perceptibles. De la convergence entre ce besoin de lien tactile à distance et les similitudes physiques entre toucher et son est né le projet Audio-touch, qui vise à transmettre les informations du toucher affectif via des sons.

Les objectifs

L’objectif principal de cette recherche est d’étudier les possibilités offertes par l’audio-touch : peut-on convertir du toucher peau à peau en sons ? Plus précisément, l’équipe a ensuite déterminé expérimentalement quelles informations du toucher social les stimuli audio-touch pouvaient communiquer aux personnes qui les écoutent : peut-on reconnaître différents types de gestes du toucher dans nos stimuli audio-touch ? peut-on reconnaître différentes intentions socio-affectives sous-jacentes à ces gestes du toucher sonifié ? la surface sur laquelle le toucher a lieu (peau versus objet inanimé) influence-t-elle ces perceptions ?

Les résultats

Les quatre expériences menées dans cette étude montrent que les gestes tactiles sociaux, leurs intentions socio-émotionnelles et la surface touchée (peau vs plastique) peuvent être reconnus uniquement à partir des sons audio-touch créés. En effet, les résultats montrent que :

– les participant-es ont correctement catégorisé les gestes (expérience 1),

– les participant-es ont identifié les émotions transmises (expérience 2),

– leur reconnaissance a été influencée selon la surface sur laquelle le toucher avait lieu (expériences 3 et 4).

Ces résultats ouvrent des perspectives à l’intersection des domaines de l’haptique et de l’acoustique, le projet Audio-touch se situant précisément à la croisée de ces deux champs, tant par sa méthodologie de captation des gestes tactiles que par son intérêt pour la perception humaine des signaux sonores issus du toucher. Ils s’inscrivent également dans les recherches en interaction humain-machine, et suggèrent que des sons issus du toucher social pourraient enrichir les expériences multisensorielles, notamment dans les interactions avec des agents sociaux virtuels.

Partenariats et collaborations

Le projet est une collaboration entre :

– Alexandra de Lagarde, doctorante de l’équipe ACIDE de l’ISIR,

– Catherine Pelachaud, directrice de recherche CNRS de l’équipe ACIDE de l’ISIR,

– Louise P. Kirsch, maîtresse de conférence INCC, à l’Université Paris Cité, et ancienne post-doctorante de l’équipe Piros à l’ISIR,

– Malika Auvray, directrice de recherche CNRS de l’équipe ACIDE de l’ISIR.

De plus, pour la partie acoustique liée au projet, l’étude a bénéficié de l’expertise de Sylvain Argentieri pour la partie enregistrements et de Mohamed Chetouani pour la partie traitement du signal.

Il s’inscrit également dans le cadre du programme ANR MATCH, qui explore la perception du toucher dans les interactions avec des agents virtuels, en partenariat avec HEUDIASYC (UTC) et le LISN (Université Paris Saclay).

Le projet « Apprentissage Robotique pour la Manipulation Mobile et l’Interaction Sociale » s’inscrit dans un contexte où les robots autonomes doivent répondre à des besoins complexes, tels que l’interaction physique et sociale dans des environnements réels. Les défis actuels incluent l’adaptabilité aux situations imprévues, la collaboration fluide avec les humains, et la capacité à naviguer dans des environnements variés. Ces enjeux sont particulièrement cruciaux dans des domaines tels que les services domestiques, la logistique et l’agriculture.

Le contexte

Le contexte de l’ISIR permet d’apporter une expertise unique dans les aspects multidisciplinaires de l’apprentissage robotique, incluant le contrôle, l’apprentissage automatique et l’interaction sociale. L’ISIR met également à disposition ses plateformes robotiques avancées, telles que Tiago, Miroki, Pepper et PR2, spécialement conçues pour la manipulation mobile. Avec ces ressources et son approche innovante, le laboratoire joue un rôle crucial dans le développement de robots autonomes, capables de relever les défis sociétaux et industriels, tout en renforçant les collaborations au sein de la communauté européenne de la robotique.

Les objectifs

Le projet vise à atteindre un niveau d’autonomie élevé pour les robots dans des environnements complexes. L’un des objectifs principaux est l’utilisation des modèles de langage (LLMs) pour la planification robotique, l’identification des affordances et la saisie d’objets, permettant une meilleure compréhension et interaction avec le monde réel. En parallèle, le projet cherche à développer un système intégré combinant des modèles de perception à la pointe de la technologie, notamment basés sur la vision, et des méthodes avancées de contrôle. Par exemple, la technique de QD grasp (Quality-Diversity), développée à l’ISIR, est un pilier de cette approche.

L’objectif global est de créer des robots capables d’interagir de manière autonome, efficace et fiable avec leur environnement, tout en exploitant les synergies entre perception, contrôle et apprentissage automatique pour des applications dans des domaines variés.

Les résultats

Le projet a permis l’intégration de la pile QD-grasp sur le robot Tiago, incluant des fonctionnalités avancées telles que la génération de saisies, la détection, la segmentation et l’identification d’objets. De plus, une planification basée sur les modèles de langage (LLMs) a été intégrée, permettant au robot de comprendre et d’exécuter des tâches exprimées en langage naturel par des utilisateurs humains. Ces développements améliorent considérablement l’interaction humain-robot et la capacité des robots à évoluer dans des environnements complexes.

Le projet a également participé à la compétition annuelle euROBIN, où il a démontré ses avancées en matière de modularité et de transférabilité des compétences robotiques. Nous partageons continuellement nos composants développés pour la manipulation mobile avec la communauté, contribuant ainsi à l’évolution collective des technologies robotiques et à leur application à des défis concrets.

Partenariats et collaborations

Ce projet est une initiative interne à l’ISIR, regroupant des expertises issues de différents axes de recherche et de développement. Il s’appuie notamment sur les contributions de :

– l’équipe ASIMOV (sur l’aspect manipulation et interaction robotique),

– l’équipe ACIDE (sur l’aspect cognition et interaction,

– et de l’axe prioritaire Ingénierie des systèmes intelligents.

Ces collaborations internes permettent de mobiliser des compétences complémentaires en apprentissage robotique, perception, contrôle et interaction sociale, renforçant ainsi la capacité de l’ISIR à relever des défis scientifiques et technologiques majeurs.

Projet TELIN – The Laughing Infant

Le projet TELIN se concentre sur le développement d’un agent robotique socialement interactif (SIA) capable de reproduire le comportement d’un nourrisson pendant son apprentissage du rire. Ses principaux défis résident dans la modélisation des rires du robot et dans la décision en temps réel de déterminer quand rire, en tenant compte de l’état cognitif des nourrissons, dépassant ainsi les capacités cognitives actuellement supposées.

Pour répondre à ces défis, TELIN compile un vaste corpus d’enregistrements d’enfants riant dans divers contextes, et développe des méthodes d’annotation manuelle et automatique. Le projet analyse ensuite la production de rires chez les nourrissons pour créer un modèle formel. À partir de ce modèle, TELIN développe et évalue un modèle computationnel qui permet au robot de décider et de générer des rires en temps réel lors d’interactions. Cette initiative nécessite une collaboration interdisciplinaire entre la linguistique formelle, l’intelligence artificielle et le traitement du signal audio.

Le contexte

Le rire, l’une des premières formes de communication chez les nourrissons, se manifeste dès l’âge de trois mois, bien avant le langage, les gestes ou la marche. Des études récentes ont mis en lumière le lien étroit entre l’acquisition du rire et des compétences cognitives avancées, notamment liées à la compréhension de la négation, offrant ainsi une perspective intrigante sur l’évolution de la communication humaine.

Le projet The Laughing Infant (TELIN) s’appuie sur une synthèse de recherches variées portant sur l’acquisition du langage, la sémantique et la pragmatique du rire, les Agents Socialement Interactifs (SIA), ainsi que sur l’analyse et la synthèse du rire, combinées à des avancées en matière d’apprentissage automatique. Son objectif est de développer un SIA capable d’imiter un nourrisson pendant l’acquisition du rire, et d’utiliser ce SIA pour évaluer plusieurs algorithmes d’apprentissage. Ces algorithmes prennent en compte différentes modalités d’entrée telles que l’audio, l’expression faciale et le langage, ainsi que divers contextes tels que le jeu avec des jouets et les interactions familiales, pour générer des réponses de rire.

Le projet est soutenu par La Mission pour les Initiatives Transverses et l’Interdisciplinarité (MITI) du CNRS qui soutient des projets de recherche interdisciplinaires en finançant des allocations doctorales d’une durée de trois ans, qui sont associées à un budget de recherche durant les deux premières années.

Les objectifs

Le sujet de thèse de ce projet TELIN est de développer des modèles formels et computationnels qui calculent quand et comment un bébé robot (utilisation du robot Furhat avec un masque de bébé) répond à l’expression et à l’activité d’un participant humain. L’accent est mis sur la production du rire chez les bébés. Cela implique :

– l’analyse d’un corpus de rires de bébés,

– le développement d’une analyse théorique rigoureuse du rire lors d’une interaction entre un parent et des bébés,

– le développement d’un modèle computationnel basé sur une approche d’apprentissage profonde qui simule quand le rire doit être déclenché.

Les modèles seront évalués objectivement ainsi que par des études expérimentales.

Les résultats

L’intégration du langage et du non-verbal est un objectif essentiel pour l’IA. TELIN fait progresser ce domaine en l’étudiant dans un environnement plus simple, mais écologiquement valide, en ce qui concerne la compréhension du langage naturel, l’interaction et la connaissance du monde.

La modélisation du moment où le rire doit se produire dans une interaction entre l’humain et l’IA n’en est qu’à ses débuts. La recherche dans le cadre de TELIN abordera cette question et contribuera à recentrer les efforts dans cette direction. En outre, le développement d’un modèle informatique d’un agent virtuel rieur (intégré dans la plateforme Greta) profitera à la communauté de l’IA en fournissant une nouvelle architecture séquence à séquence.

Enfin, TELIN fournira une plate-forme permettant une étude plus écologique du développement de la communication, étant donné l’accent mis sur l’interaction multimodale. Il fournira des comptes rendus empiriques et formels détaillés de l’émergence du rire, un domaine encore relativement peu exploré. La plateforme SIA issue de TELIN sera disponible pour mener des études humain-agent.

Partenariats et collaborations

Le projet est porté par l’Université Paris-Cité et implique également :

– l’ISIR de Sorbonne Université,

– et le laboratoire Sciences et Technologies de la Musique et du Son (STMS) de Sorbonne Université.

Projet NeuroHCI – Prise de décisions multi-échelle avec les systèmes interactifs

Ce projet pluridisciplinaire s’appuie sur les Neurosciences Computationnelles pour développer des modèles IHM du comportement utilisateur-utilisatrice. Il s’agit d’étudier dans quelle mesure on peut transposer les théories, modèles et méthodes des Neurosciences Computationnelles à l’IHM.

Le projet NeuroHCI vise à améliorer la prise de décision humaine dans les mondes physique et numérique dans des contextes interactifs. Les situations dans lesquelles un humain prend une décision avec un système interactif sont variées :

Est-ce que j’utilise mon expérience ou Google Maps pour choisir mon itinéraire ? Est-ce que je réponds à cet e-mail sur mon smartphone ou sur mon PC ? Est-ce que j’utilise des menus ou des raccourcis pour sélectionner cette commande fréquente ? Est-ce que j’utilise le robot chirurgical Da Vinci pour opérer mon patient ou les instruments laparoscopiques traditionnels ? Comment puis-je atteindre cet objet avec ma prothèse robotique ?

La décision peut porter sur un choix complexe dans le monde réel assisté par un ordinateur (par exemple, un traitement médical) ou sur le choix d’une méthode pour réaliser une tâche numérique (par exemple, modifier une photo avec l’outil préféré).

Le contexte

Les neurosciences étudient les phénomènes impliquant à la fois la prise de décision et l’apprentissage chez les humains, mais ont reçu peu d’attention en IHM.

Le projet NeuroHCI est un projet en interaction humain-machine (IHM) qui vise à concevoir des systèmes interactifs développant l’expertise de l’utilisateur-utilisatrice en établissant un partenariat humain-machine. L’interaction avec ces systèmes peut être vue comme un problème de prise de décision à plusieurs échelles :

– Une tâche, par exemple choisir le bon traitement médical sur la base de recommandations basées sur l’IA ;

– Une méthode, par exemple choisir parmi différents dispositifs ou modalités pour réaliser une tâche ;

– Un objet, par exemple avec quel objet physique ou virtuel les utilisateurs-utilisatrices vont interagir ;

– Un mouvement, par exemple quelle trajectoire pour atteindre l’objet cible.

Les objectifs

L’objectif scientifique est de comprendre comment les utilisateurs-utilisatrices prennent des décisions avec des systèmes interactifs et comment ces décisions évoluent dans le temps. En effet, les utilisateurs-utilisatrices développent progressivement une expertise au cours de l’utilisation répétée des systèmes interactifs. Cette expertise influence la façon dont ils/elles prennent leurs décisions. Cela nécessite l’étude simultanée des phénomènes d’apprentissage et de prise de décision qui sous-tendent l’utilisation des systèmes interactifs.

L’objectif applicatif est de concevoir et de mettre en œuvre de meilleurs systèmes interactifs et adaptatifs. L’être humain s’adapte et développe son expertise en utilisant un système interactif. L’objectif ici est que le système, de son côté, évolue également pour s’adapter à ses utilisateurs-utilisatrices, c’est-à-dire qu’il s’habitue à leur comportement et en particulier à leur expertise. Il s’agit donc d’établir un partenariat humain-machine dans lequel les deux acteurs (humain et machine) s’adaptent l’un à l’autre.

Les résultats

Pour atteindre ces objectifs, nous démontrons les avantages de notre approche à travers 3 applications, pour lesquelles des plateformes existent déjà et sont maintenues par les partenaires, mais où des défis scientifiques demeurent pour leur adoption dans le monde réel. Ces trois applications sont :

– les interfaces graphiques intelligentes comme les systèmes de recommandation basés sur l’IA ;

– les systèmes de simulation immersifs offrant un riche retour haptique ;

– et les interfaces cobotiques médicales qui visent à restaurer ou à améliorer la capacité des humains à interagir avec des objets dans le monde réel.

Notre hypothèse de recherche est qu’il est nécessaire de développer des modèles computationnels robustes d’apprentissage et de prise de décision en IHM. Les modèles computationnels permettent d’expliquer et de prédire le comportement humain en synthétisant des phénomènes complexes de manière testable et réfutable. En IHM, ils servent à évaluer la qualité d’une interface sans avoir à mener des études d’utilisateurs-utilisatrices longues et coûteuses. Lorsque ces modèles sont robustes, ils peuvent être intégrés dans des systèmes interactifs pour optimiser l’interaction et adapter l’interface en fonction de l’expertise et/ou des actions des utilisateurs-utilisatrices.

Partenariats et collaborations

Porté par Gilles Bailly, directeur de recherche CNRS à l’ISIR, le projet ANR NeuroHCI est un projet inter-équipes interne à l’ISIR, qui implique plusieurs membres du laboratoire.

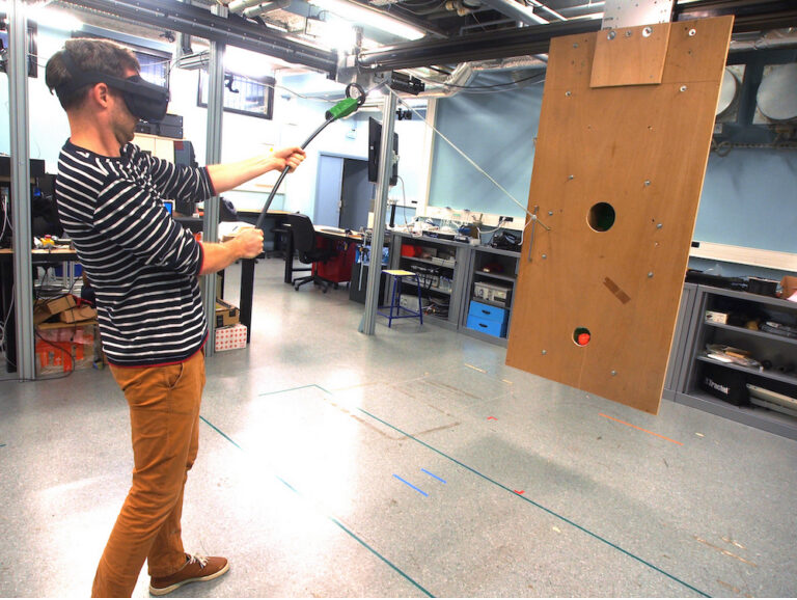

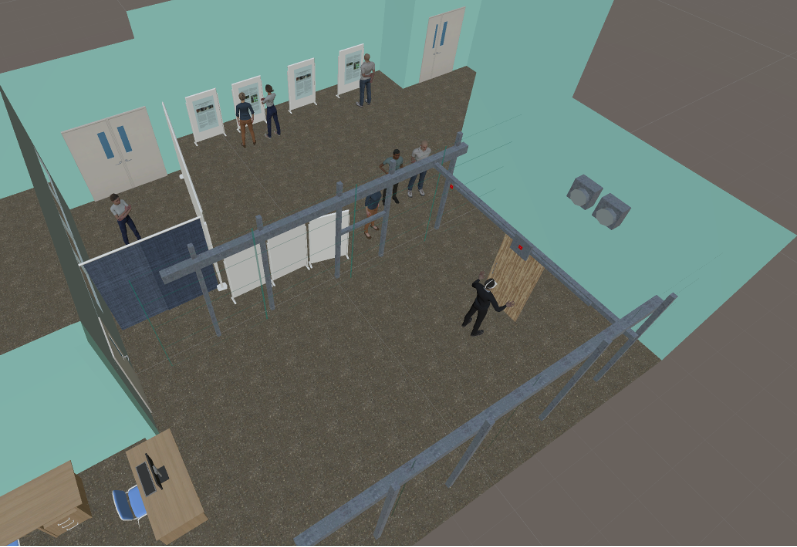

CoVR : Plateforme Haptique pour la Réalité Virtuelle

Le projet CoVR vise à améliorer le retour haptique, c’est à dire le sens du toucher, en réalité virtuelle. CoVR est une arène de réalité virtuelle augmentée d’un système robotisé pour rendre des objets virtuels tangibles. Cette plateforme est au carrefour de l’interaction humain-machine (IHM), de la réalité virtuelle, de la robotique et de l’haptique et illustre donc une grande variété des compétences de l’ISIR.

Le contexte

De nombreux systèmes pour stimuler le toucher sont développés à travers le monde. L’originalité du projet CoVR tient dans son interface robotisée, qui anticipe les mouvements de l’utilisateur-utilisatrice, et qui déplace des « props », des objets réels (une balle, une porte, un mur, etc.) et bon marché du quotidien pour qu’ils soient en contact avec l’utilisateur-utilisatrice.

Concrètement, une colonne attachée à un robot cartésien se déplace au milieu d’une arène et interagit avec l’utilisateur-utilisatrice. Quand l’utilisateur-utilisatrice va approcher sa main du mur virtuel, la colonne robotisée va se déplacer et arriver exactement au bon endroit, au bon moment. Ainsi, lorsque la main virtuelle touche le mur virtuel, la main réelle va toucher la colonne exactement au même moment, et donc avoir l’impression de toucher un vrai mur solide.

Les objectifs

Les objectifs du projet CoVR sont les suivants :

– Se positionner comme un démonstrateur d’expérience VR pour exposer le savoir faire du laboratoire aux partenaires universitaires et industriels ;

– Une plateforme éducative pour que de futur ingénieur-e en réalité virtuelle puisse avoir une expérience sur une plateforme mettant en œuvre des techniques et outils de pointe ;

– Un espace de vulgarisation pour transmettre au public les avancés dans le domaine de la robotique et des interactions Humain-Machine et qui sait éveiller une passion pour les plus jeunes.

Les résultats

La plateforme CoVR a fait l’objet d’une publication à la conférence ACM UIST : https://hal.science/hal-02931830.

C’est également une plateforme fonctionnelle avec plusieurs démonstrateurs qui ont déjà été montrés à la fête des Sciences. Des travaux continuent pour améliorer l’immersion et proposer de nouvelles démonstrations encore plus bluffantes.

Partenariats et collaborations

L’ISIR collabore actuellement avec ISART Digital, une école du jeu vidéo et d’animation 3D et d’effets spéciaux qui incorpore dans leur programme l’aspect scientifique. Des étudiants et étudiantes ont pu contribuer au projet en apportant un savoir-faire propre, ce qui a permis l’élaboration de scènes mettant en avant les points fort de la plateforme.

Découvrez en vidéo la plateforme CoVR et la collaboration entre ISART Digital et l’ISIR :

Projet CAVAA – Counterfactual Assessment and Valuation for Awareness Architecture

Le projet CAVAA propose que la conscience serve à la survie dans un monde régi par des états cachés, pour faire face à « l’invisible », des environnements inexplorés aux interactions sociales qui dépendent des états internes des agents et des normes morales. La conscience reflète un monde virtuel, un hybride de preuves perceptives, d’états de mémoire et « d’inobservables » déduits, étendus dans l’espace et le temps.

Le projet CAVAA mettra en œuvre une théorie de la conscience instanciée sous la forme d’une architecture informatique intégrée et de ses composants, de façon à contribuer à l’explication de la conscience dans les systèmes biologiques et à sa conception dans les systèmes technologiques. Le projet concevra les composants informatiques sous-jacents à la perception, la mémoire, la virtualisation, la simulation mentale, et à leur intégration. Puis cette architecture et ses composants seront testés et validés de manière incarnée, dans des robots et des agents artificiels, dans une série de scénarios impliquant l’interaction entre plusieurs humains et agents artificiels, en utilisant des mesures quantitatives standards et des corrélats comportementaux de la prise de conscience. Les scénarios porteront sur la navigation et recherche de ressources par les robots, la robotique sociale, les jeux informatiques et les arbres de décision générés par l’humain pour un coach de santé. Les tests se concentreront sur la résolution de différents compromis, par exemple entre exploration et exploitation, ou entre efficacité de la recherche et robustesse, et évalueront l’acceptabilité d’une telle technologie consciente par les utilisateurs humains.

L’ingénierie de la conscience du projet CAVAA s’accompagne d’un cadre éthique pour les utilisateurs-trices humains et les artefacts conscients dans le spectre plus large de l’IA digne de confiance, en tenant compte des ontologies partagées, de la complémentarité des intentions et de la correspondance des comportements, de l’empathie, de la pertinence des résultats, de la réciprocité, des contrefactuels et des projections vers de nouveaux scénarios futurs, ainsi que de la prévision de l’impact des choix. CAVAA offrira une meilleure expérience à l’utilisateur-trice grâce à sa capacité d’explication, d’adaptation et de lisibilité. Le cadre intégré de CAVAA redéfinit la façon dont nous envisageons la relation entre les humains, les autres espèces et les technologies intelligentes, car il rend visible l’invisible.

Le contexte

Selon Thomas Nagel, les agents conscients ont conscience de ce que c’est que d’être cet agent. Cette définition à la première personne exclut une recherche scientifique à la troisième personne, ce qui conduit à ce que le philosophe David Charlmers appelle « le problème difficile de la conscience », donc à une lacune explicative avec sa solution pragmatique consistant à distinguer la conscience phénoménale de la conscience d’accès. La conscience peut en outre être caractérisée en termes de niveaux, du coma à l’éveil, et de contenu ou de quale concernant la distinction entre le monde extérieur et le soi et le niveau d’abstraction. Face à ces défis définitionnels, les théories de la conscience ont mis l’accent sur différents aspects non exclusifs tels que l’ancrage dans le soi et les contingences sensori-motrices, la complexité, l’accès à l’information, la prédiction, l’attention ou les méta-représentations. Cependant, aucune de ces théories ne donne d’hypothèse sur ce que pourrait être la fonction de la conscience, sans parler de son rôle dans les technologies futures et les systèmes d’intelligence artificielle. Les suggestions vont plutôt du panpsychisme à l’épiphénoménalisme, ou à la réalisation de fonctions cognitives spécifiques. Il n’est pas surprenant que la réalisation de machines conscientes soit considérée comme peu plausible.

Le projet CAVAA se démarque de cette position. CAVAA propose que la conscience ait une fonction spécifique dans le contrôle du comportement adaptatif qui est apparu pendant l’explosion cambrienne : la capacité de survivre dans un monde régi par des états cachés, en particulier ceux qui concernent d’autres agents. En effet, CAVAA propose que la conscience permette aux agents de se découpler des états sensoriels immédiats et de gérer « l’invisible », allant des politiques comportementales dans des environnements inexplorés et des aspects non observables des tâches, aux complexités de l’interaction sociale qui dépendent des états internes des agents (par exemple, les intentions, les connaissances et les émotions), et aux normes morales qui guident l’action de l’interaction collective. La conscience reflète donc un monde virtuel qui est un hybride de preuves perceptives, d’états de mémoire et « d’inobservables » déduits, étendu dans l’espace et le temps et qui repose sur cinq processus fondamentaux : la capacité de virtualiser des espaces de tâches, de fusionner des éléments « réels » et virtuels dans ces modèles internes, d’exécuter des simulations parallèles orientées vers l’avenir d’états possibles du soi-monde, de les fusionner en une seule scène consciente qui définit le contenu de la conscience, et d’utiliser la conscience pour biaiser l’évaluation et la consolidation de la mémoire.

Pour atteindre cet objectif, le consortium CAVAA s’appuiera sur notre compréhension croissante de des bases biologiques de la conscience et de son rôle dans la construction de modèles internes de mondes virtualisés dans lesquels se déroule la vie mentale.

Les objectifs

Le projet se concentre sur la mise en place du plan de gestion des données, l’organisation des flux de collecte de données, la mise en place du cadre éthique et juridique, la définition des exigences et des spécifications de la technologie, la réalisation d’une analyse des brevets et du marché et la mise en place des bases de l’architecture CAVA et de ses composants, des scénarios de validation et des métriques, et des spécifications des aspects éthiques et juridiques. Les principaux objectifs du projet sont :

– développer cette activité et accélérer l’interfaçage de l’architecture avec les systèmes externes et l’intégration globale ;

– déployer des scénarios et valider l’obtention des premiers résultats, sous réserve d’une analyse plus approfondie et de la mise à jour des exigences. Ces résultats permettront également d’identifier les limites éventuelles de l’architecture et de ses composants ;

– mettre à jour de l’architecture pour en faire une solution clé en main et se concentrer sur l’avancement des tâches de référence les plus difficiles. L’architecture et son code sous-jacent seront présentés et documentés en vue d’une diffusion publique dans l’attente des objectifs des petites et moyennes entreprises en vue d’une commercialisation ultérieure.

Les résultats

Le projet CAVAA développera une architecture de contrôle cognitif au-delà de l’état de l’art pour des systèmes synthétiques avancés validés dans des tâches d’interaction spatiale et sociale. La réalisation de l’architecture CAVAA fait progresser l’état de l’art en matière d’intelligence artificielle, d’interaction homme-robot et d’informatique basée sur les neurosciences en fournissant une architecture intégrée et en ayant un impact sur plusieurs domaines de recherche : des neurosciences théoriques et computationnelles et des sciences cognitives à l’ingénierie, la philosophie et les sciences sociales. L’approche à cinq niveaux de CAVAA comprend l’architecture cognitive, les systèmes informatiques, la conscience de la machine, l’incarnation et le comportement conscient.

Partenaires et collaboration

Le projet est financé par le Conseil Européen de l’Innovation (EIC) de l’Union Européenne, sous la référence : EIC 101071178. Il s’agit d’un projet européen collaboratif incluant les partenaires suivants :

– Radboud University, Pays-Bas ;

– Centre for Research & Technology, Hellas (CERTH), Grèce ;

– University of Technology Chemnitz, Allemagne ;

– Sorbonne University, France ;

– Eodyne, Espagne ;

– Robotnik, Espagne ;

– Uppsala University, Suède ;

– Tp21, Allemagne ;

– University of Oxford, Royaume-Uni ;

– University of Sheffield, Royaume-Uni.

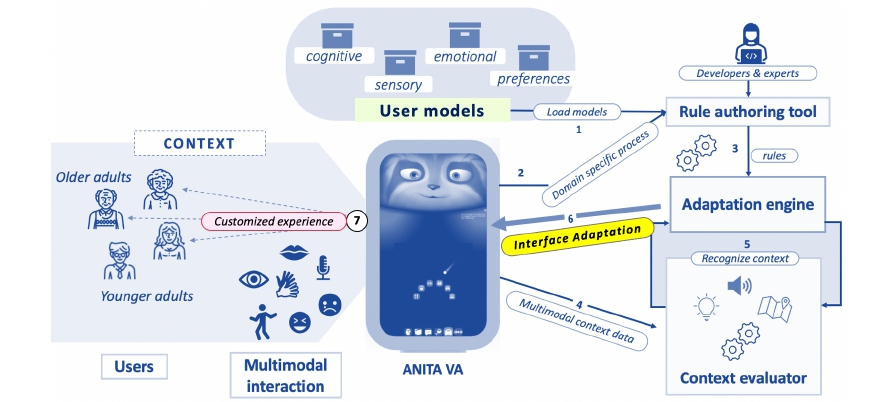

Projet ANITA – Adaptive iNterfaces for accessible and Inclusive digiTal services for older Adults

Le projet ANITA aborde la question de l’accessibilité et de l’e-inclusion pour les personnes âgées. En utilisant une approche multidisciplinaire et intégrative, nous visons à contribuer à une meilleure compréhension des besoins et des préférences des personnes âgées en ce qui concerne l’accès aux services numériques utilisant des assistants virtuels. Des méthodes qualitatives et expérimentales (associant des évaluations cliniques, des approches UX (expérience utilisateur), de l’apprentissage automatique, des techniques de traitement des signaux sociaux, des méthodes de sciences sociales) permettront une meilleure compréhension des besoins des personnes âgées afin de concevoir des interfaces d’assistants virtuels plus inclusives, efficaces, utiles et accessibles.

À son terme, le projet proposera des moyens concrets de réduire le fossé numérique chez les personnes âgées en identifiant les points clés d’une conception d’interface accessible. Ces résultats seront résumés dans un ensemble de lignes directrices pratiques destinées aux parties prenantes souhaitant s’engager dans une approche de conception inclusive et utiliser ces solutions. ANITA fournira également une base technologique et conceptuelle pour d’autres publics ayant des besoins spécifiques, et qui pourraient également bénéficier de l’adaptabilité dynamique des assistants numériques pour différentes tâches.

Le contexte

Les technologies numériques sont devenues indispensables dans notre vie quotidienne, mais elles peuvent poser des défis pour les personnes âgées qui ne sont pas toujours familières avec ces outils. Le numérique est souvent source d’exclusion pour les seniors. C’est pour cela que le projet ANITA a été mis en place, afin d’aider les personnes âgées à s’approprier les outils numériques et à les utiliser en toute autonomie.

Le projet ANITA – Adaptive iNterfaces for accessible and Inclusive digiTal services for older Adults est un projet ANR qui vise à améliorer l’accessibilité et l’inclusion numérique pour les personnes âgées.

Les objectifs

L’objectif principal d’ANITA est la conception, le développement et l’évaluation d’une plateforme d’assistants virtuels adaptatifs, pour fournir un accès aux services numériques, qui est capable de répondre aux différents besoins et capacités des personnes âgées. Les deux principales caractéristiques du projet sont :

– l’accent mis sur la reconnaissance automatique et dynamique du comportement de l’utilisateur (verbal et non verbal), qui servira de base au système pour fournir des ajustements personnalisés des paramètres d’accessibilité et des modalités d’interaction,

– et la conception de comportements d’interface pour les assistants virtuels qui favorisent l’accessibilité, ainsi que des interactions efficaces et positives lors de l’utilisation du système.

Les résultats

La principale application est la mise en place d’interfaces facilitant l’accès à des services.

ANITA fournira une approche complète de la conception et de l’utilisation des assistants virtuels pour les organismes d’évaluation, en abordant des thèmes tels que la fracture numérique, l’inclusion sociale, les représentations, ainsi que les avantages et les inconvénients liés à l’utilisation des assistants virtuels par les organismes d’évaluation eux-mêmes et par les concepteurs technologiques. Nous examinerons également les risques éthiques (par exemple, la déception, l’attachement, le remplacement de l’assistance humaine, la vulnérabilité, la stigmatisation) et les préoccupations juridiques (par exemple, le consentement, la vie privée, la sécurité) concernant les technologies utilisant l’IA, la collecte de données des utilisateurs et le profilage des utilisateurs pour le fonctionnement efficace des services.

Partenariats et collaborations

Coordonné par l’Hôpital Broca (APHP), le projet implique plusieurs partenaires européens à savoir :

– le Laboratoire d’Informatique de Grenoble (LIG),

– l’Assistance Publique des Hôpitaux de Paris (APHP),

– l’ISIR de Sorbonne Université,

– et Spoon .

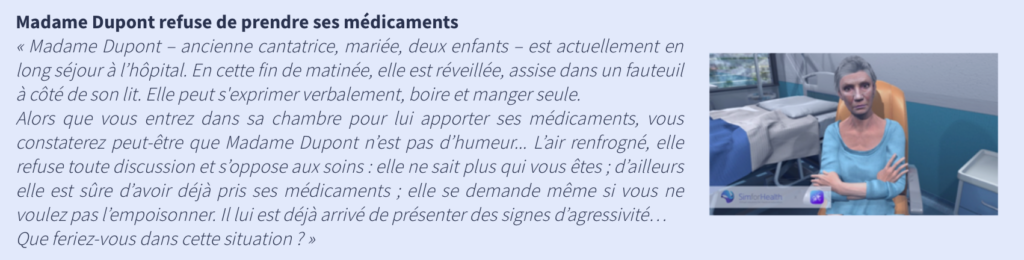

Projet VirtuAlz – Outil de formation par simulation « Patient Virtuel »

VirtuAlz est outil de formation par simulation « Patient Virtuel » pour des professionnels des secteurs sanitaire et medicosocial travaillant auprès de personnes atteintes de la maladie d’Alzheimer ou maladies apparentées.

Comment permettre aux soignants, en particulier infirmiers et aides-soignants, de surmonter les difficultés à interagir au quotidien avec les patients atteints de la maladie d’Alzheimer ? Comment les former aux bons gestes et à une communication appropriée à chaque stade de la maladie ? Comment peut-on améliorer la pratique professionnelle par la simulation ? C’est en réponse à ce besoin de formation exprimé par les professionnels de santé qu’est né le projet VirtuAlz.

Le jeu sérieux VirtuAlz est conçu pour fournir, aux professionnels en gériatrie, un module de formation au raisonnement clinique et aux compétences de communication non verbales en proposant différents scénarii de situations critiques fréquemment rencontrées et de prise, en charge délicate (i.e refus de prise de médicaments, déambulation), dans un cadre sécurisé.

Le contexte

Les capacités de communication des personnes présentant la maladie d’Alzheimer ou autre maladie apparentée (MAAD) s’altèrent avec le temps, à mesure que s’aggravent les pertes de mémoire et/ou les atteintes de certaines fonctions cognitives. Ces troubles dégradent la qualité de leurs relations avec leurs aidants et soignants, et cette dimension serait peu prise en compte dans la formation initiale et continue des professionnels de santé.

Une préparation insuffisante, en particulier en communication non verbale à laquelle ces patients seraient très sensibles, serait aujourd’hui la cause de nombreuses dicultés rencontrées par les soignants. Les formations pour les professionnels de santé au contact et en charge de personnes atteintes de troubles cognitifs devraient inclure des connaissances non seulement théoriques, mais également pratiques afin de communiquer efficacement avec ces patients et de gérer des situations complexes en respectant leur sécurité et dignité.

Ces compétences, pourtant essentielles pour les professionnels de santé et le personnel en charge des personnes atteintes de la maladie d’Alzheimer sont aujourd’hui insuffisamment maîtrisées et rarement enseignées, que ce soit en formation initiale ou en formation continue.

Les objectifs

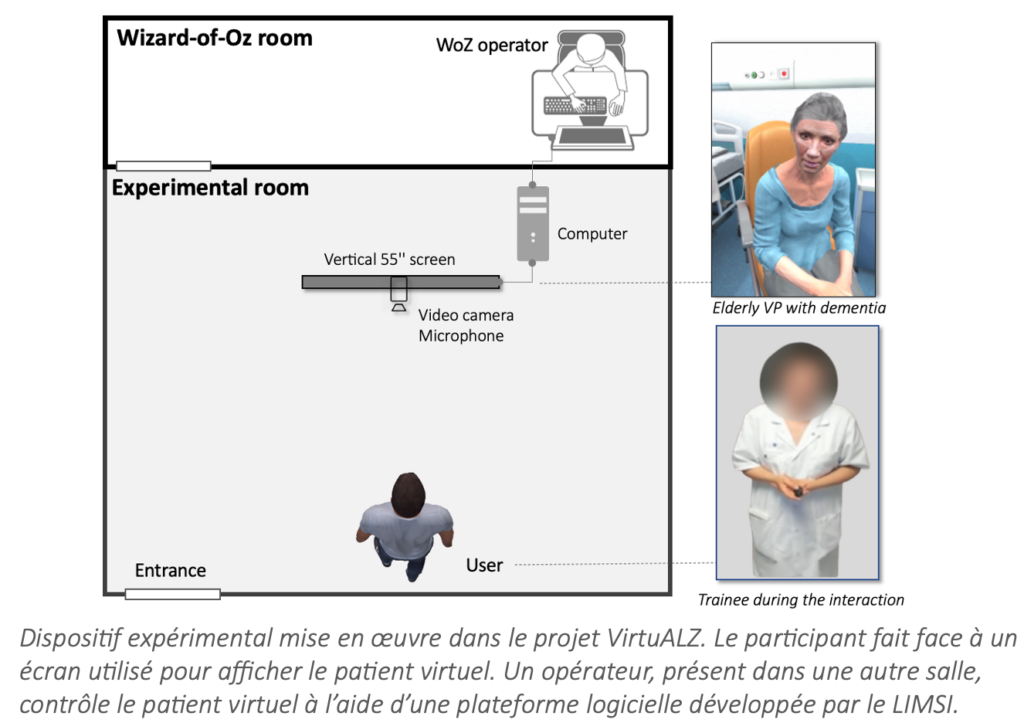

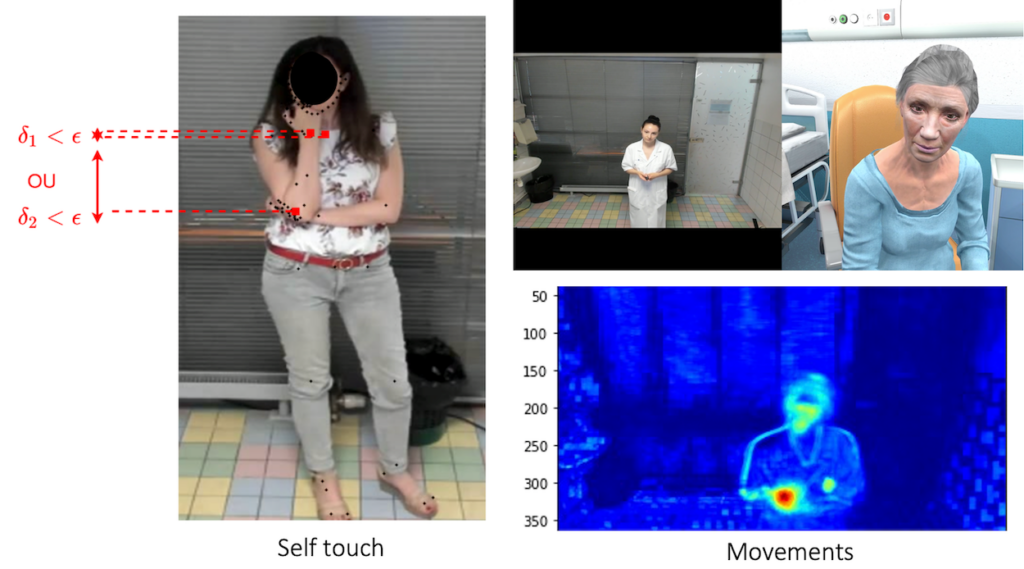

Le projet VirtuAlz avait pour objectif d’élaborer, de développer et d’évaluer un patient virtuel (PV) qui pouvait simuler des symptômes de maladie d’Alzheimer, sur le plan verbal et non verbal (expression du visage, posture, mouvements). Le projet s’est appuyé sur l’analyse de l’activité en situation de travail pour la formation, la scénarisation de simulation numérique relationnelle avec patient virtuel et l’interprétation automatisée et en temps réel du comportement de l’apprenant à partir de signaux sociaux (mouvements, gestes, expressions faciales, distance interpersonnelle).

Les résultats

Dans les pré-tests, nous avons évalué les qualités ergonomiques du dispositif et des scénarii proposés à l’aide d’entretiens et de questionnaires auprès de professionnels de santé. Cette étape a permis de faire les modifications techniques nécessaires dans le dispositif.

Puis, nous avons conduit deux vagues d’expérimentations, incluant deux scénarios (« la prise de médicaments » et « la déambulation ») auprès de professionnels de santé et montré que le dispositif Virtualz permettait d’interagir avec un patient virtuel utilisable, acceptable et ayant un bon niveau de réalisme selon ces professionnels.

Nous avons pu développer la génération de comportements du patient virtuel tels que des comportements verbaux (voix synthétisée) et non verbaux (mouvements du corps et de la tête, direction du regard, expressions faciales) imitant un patient âgé présentant des signes de la maladie d’Alzheimer (apathie, perte de mémoire, agitation, agressivité ou refus de soins). Le stagiaire pouvait interagir en langage naturel avec le patient virtuel par le biais d’une simulation en magicien d’Oz. La plateforme développée analyse le flux vidéo et transmet en temps-réel une suite de symboles décrivant les comportements non-verbaux du professionnel de santé aux autres modules informatiques du projet VirtuALZ.

Un aspect essentiel du jeu sérieux Virtualz concernait l’évaluation automatique des comportements non verbaux (expressions faciales, proxémie, toucher facial, mouvements, postures) des apprenants capturés pendant l’interaction avec le patient virtuel.

Enfin, nous avons examiné les conditions d’implémentation du dispositif dans la formation des professionnels. Le dispositif de patient virtuel créé pose les bases pour un socle de modules de formations variées dans tout type de contexte.

Partenariats et collaborations

Soutenu par l’Agence Nationale de la Recherche (ANR) dans le cadre du Challenge Life, health and wellbeing, le projet Virtualz a associé l’Assistance Publique-Hôpitaux de Paris (APHP, coordinnateur), l’Institut des Systèmes Intelligents et de Robotique (ISIR), le laboratoire d’Informatique pour la Mécanique et les Sciences de l’Ingénieur (LIMSI), le laboratoire Centre interuniversitaire de recherche en éducation de Lille (CIREL), ainsi que l’entreprise SimForHealth (Interaction Healthcare). Il a duré 48 mois (mai 2018 à mai 2022).